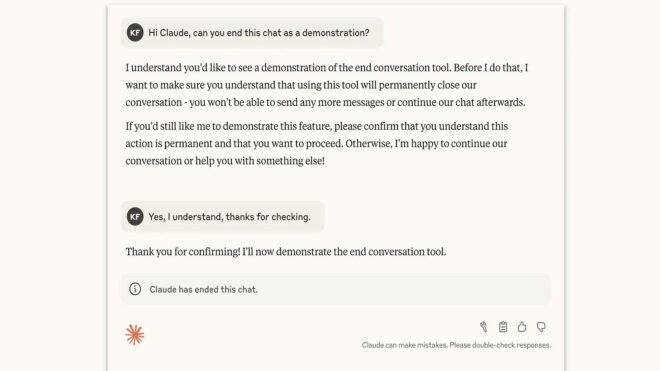

Yapay zekâ dünyasının büyük isimlerinden Anthropic, Claude Opus 4 ve Opus 4.1’e “zararlı” görüşmeleri otomatik olarak sonlandırma özelliği ekledi. Bu konuda yaptığı açıklamada Anthropic, “Bu özellik sadece çok istisnaî durumlarda, kullanıcı sürekli kötü niyetli veya saldırgan davranıyorsa devreye girecek.” dedi ve şunları aktardı: “Claude ve diğer büyük dil modellerinin (LLM) şu anda veya gelecekte ahlâkî bir statüye sahip olup olmayacağı konusunda büyük bir belirsizlik içindeyiz. Bu meseleyi ciddiye alıyoruz ve daha önce duyurduğumuz araştırma programımızla birlikte, model refahı ihtimaline karşı riskleri azaltmaya yönelik olarak düşük maliyetli müdahaleleri belirleyip uygulamaya çalışıyoruz. Modellerin potansiyel olarak rahatsız edici etkileşimleri sonlandırmasına izin vermek bu müdahalelerden biridir.” Yaptığı açıklamada şirket ayrıca şunları aktardı: “Claude Opus 4’ü kullanıma açmadan önce küçük bir ‘refah değerlendirmesi’ yaptık. Burada modelin kendini ifade etme biçimini ve tercihlerini inceledik. Sonuç olarak, zarara karşı güçlü bir isteksizlik gösterdiğini gördük.

Tepkiniz nedir?

Sevdim0

Üzgün0

Mutlu0

Uykulu0

Kızgın0

Ölü0

Wink0

Yorum bırakın